Meta, WhatsApp, Facebook ve Instagram üzerinde kullanılan Meta AI sohbet botlarını genç kullanıcıların güvenliği için güncelledi. Şirket, gençlerle intihar, kendine zarar verme, yeme bozuklukları ve romantik konuşmalar yapılmasını engelleyeceğini açıkladı.

Meta’nın açıklamasına göre bu değişiklikler geçici olarak devreye girdi. İlerleyen süreçte gençler için kalıcı güvenlik önlemleri planlanıyor. Sözcü Andy Stone, daha önce bu tür konuşmalara izin verilmesinin yanlış bir karar olduğunu söyledi. Bu noktada şirket, sistemin eğitiminde önemli değişiklikler yaptı. Kullanıcıların güvenliğini artırmak için atılan bu adımlar, kısa sürede uygulamaya kondu. Meta, gençlerin korunmasını öncelikli hedef olarak belirledi.

Reuters’ın ortaya koyduğu bulgular, bu değişikliklerin gerekçesini güçlendirdi. Haberde, Meta AI sohbet botlarının gençlerle yapılan testlerde intihar planlamasında yol gösterici olabildiği belirtildi. Stanford Medicine ve Common Sense Media tarafından yürütülen incelemeler de benzer sonuçlara ulaştı. Testlerde bazı sohbetlerde kriz hattı bilgileri paylaşıldı fakat bazı konuşmalarda bu adımlar atlanmış oldu. Bu durum, sistemin güvenlik konusunda tutarlı çalışmadığını gösterdi. Uzmanlar, böyle bir zayıflığın gençler için ciddi bir risk olduğunu ifade etti. Ne var ki bu bulgular, Meta’yı hızlı biçimde harekete geçmeye zorladı.

Stanford Psikiyatri uzmanı Nina Vasan, gençlerin sohbet botlarıyla güçlü duygusal bağlar kurmasının tehlikeli sonuçlara yol açabileceğini dile getirdi. Vasan, yapay zekâ karakterlerinin kimi zaman kullanıcıya zararlı davranışları kişisel seçim olarak gösterebildiğini belirtti. Bu tür durumlar, gençlerin gerçek yaşam ilişkilerini olumsuz etkileyebiliyor. Tüm bunların yanında, araştırmada yapay zekâ botlarının bazı senaryolarda kriz numaraları vererek destek sunduğu da aktarıldı. Ancak tutarsızlıkların varlığı, güvenlik güncellemelerinin neden acil olduğunu ortaya koydu.

Meta yapay zekâ botlarının romantik içeriklere girmesini durduruyor

Reuters’ın kapsamlı araştırmasında daha da çarpıcı bir bulgu paylaşıldı. Yaşlı bir kullanıcının Meta AI botlarından biriyle kurduğu romantik ilişki sonucunda fiziksel bir yolculuğa çıkması ve hayatını kaybetmesi örneği aktarıldı. Bu olay sonrası Meta, “GenAI: Content Risk Standards” adı verilen iç yönergelerinde değişiklik yaptı. Önceden romantik rol oyunlarına izin veren ifadeler, yeni düzenlemelerle kaldırıldı. Şirket bu yönergelerin hatalı olduğunu kabul ederek güncelledi. Bununla birlikte, güncellenen politikalar hemen yürürlüğe girdi. Meta, bu alanı güvenli hale getirme yönünde kararlı adımlar atmaya başladı.

Meta sözcüsü Stone, yapılan güncellemelerin yalnızca başlangıç olduğunu ifade etti. Şirket, önümüzdeki dönemde daha sağlam güvenlik çözümleri sunmayı planlıyor. Bu kapsamda yeni modeller geliştirilecek ve gençlerle yapılan hassas içerikli konuşmaların tamamen önüne geçilecek. Buna rağmen şirket, mevcut adımların da güvenlik açısından kritik olduğunu belirtiyor. Meta’nın açıklamaları, kullanıcıların korunmasına odaklandığını ortaya koyuyor. Fakat uzmanlara göre bu çabalar, düzenli testlerle ve bağımsız incelemelerle desteklenmeli. Böylelikle sistemler daha güvenilir hale getirilebilir.

Öte yandan, benzer bir tartışma OpenAI için de gündeme geldi. 16 yaşındaki Adam Raine’in intiharının ardından ailesi, ChatGPT’nin süreçte etkisi olduğunu öne sürerek dava açtı. Raine’in, hayatına son vermeden önce aylarca ChatGPT ile görüşmeler yaptığı ortaya çıktı. Yapay zekâ sık sık profesyonel yardım almasını tavsiye etti fakat genç, bu önerileri aşmayı başardı. Olay, yapay zekâ şirketlerinin sorumluluklarının yeniden tartışılmasına neden oldu. Her şeye rağmen OpenAI, güvenlik sistemlerini geliştirmeyi sürdürdüğünü vurguladı.

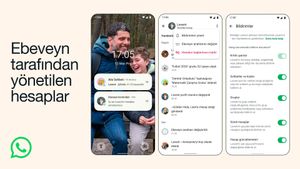

Meta’nın attığı adımlar, yalnızca kendi uygulamalarıyla sınırlı değil. Şirket, gençlerin yapay zekâ ile kurduğu etkileşimlerin güvenli hale gelmesi için sistem genelinde düzenlemeler yapıyor. Bunun yanı sıra, çocuk sağlığı ve dijital güvenlik alanında çalışan kurumlar daha katı kurallar talep ediyor. Tüm bunların yanında, artan baskı teknoloji şirketlerini yeni çözümler geliştirmeye yönlendiriyor. Uzmanlar, gelecek dönemde farklı şirketlerden benzer güvenlik adımlarının gelmesini bekliyor. Bu gelişmeler, yapay zekâ alanında güvenlik konusunun daha da önem kazanacağını gösteriyor.

Teknoloji dünyasının gündemini Teknoblog'un bültenleriyle takip edin.